ChatGPT es una herramienta con múltiples utilidades, pero su reciente fama no lo aleja de tener errores y de presentar fallos que demuestran que es una tecnología en progreso y con un amplio margen de mejora.

Hay muchos motivos que explican por qué se da esta situación, que van desde el propio desarrollo de la inteligencia artificial de OpenAI hasta las indicaciones que dan los usuarios al momento de realizar las peticiones.

Así que si en algún momento el chatbot ha arrojado respuestas incorrectas o alucina con los contenidos generados, puede ser por uno de los siguientes motivos.

Limitación de información

La versión gratuita de ChatGPT está desarrollada con GPT-3, que es la inteligencia artificial que nutre la información, que luego la plataforma usa para crear el contenido que el usuario le pide.

Esa tecnología cuenta con una gran limitación: no tiene datos de lo que sucedió después de septiembre de 2021. Así que todo lo que se le pida después de esa fecha será información equivocada o aceptará que no conoce de lo que se le está preguntando.

El ejemplo más evidente es que nos sabe quién ganó el Mundial 2022 en Qatar.

“Lo siento, pero como modelo de lenguaje, no tengo acceso a información del futuro. El Mundial de Fútbol de 2022 aún no ha ocurrido y no tengo manera de saber quién será el ganador”, es la respuesta del chatbot a esa pregunta.

Esto es fundamental saberlo en caso de querer obtener información de lo que ha sucedido en los dos últimos años, porque el sistema no lo va a saber y no hay manera de enseñarlo, por lo menos del lado del usuario.

Más detalles, menos probabilidad de errores

ChatGPT es un chatbot diferente a los servicios que ofrecen las empresas para optimizar el contacto con sus usuarios, en el que entre menos información se dé y se hable con palabras claves, las repuestas van a ser mejores.

Esta inteligencia artificial necesita que las personas sean claras con lo que quieran y no divaguen, porque de lo contrario ella hará lo mismo y los resultados serán genéricos.

Un ejemplo es no preguntar cosas generales como: cuéntame la historia del hombre. En ese caso, la mejor opción es delimitar la petición con un rango de tiempo específico, un hecho o un enfoque puntual, como por ejemplo: la historia del hombre durante la civilización romana o cómo vivió el hombre en la Segunda Guerra Mundial.

En este punto también es importante direccionar la respuesta, es decir, si se necesita una recomendación de una receta para alguien con diabetes, es fundamental incluir eso en la petición para que el chatbot entienda hacia adonde apunta el usuario.

Todo esto es clave porque la IA suele caer con facilidad en fallas ante la falta de contexto, por ejemplo, no es lo mismo que cree un guion para un video en YouTube, que para un programa de televisión.

Más conversación

ChatGPT tiene la facultad de responder a los comentarios que se van desarrollando en el historial de la conversación. Esto permite que no sea necesario repetir una petición, sino usar lo que se ha hablado para agregar mayor precisión o moldear el contenido generado.

Por ejemplo, le pedimos que contara la historia del hombre durante la civilización romana, lo primero que hizo fue darnos toda la información de una forma neutral y técnica. Luego agregamos un comentario diciendo solamente: ‘ahora cuéntalo de una forma graciosa’, y lo que hizo fue generar un texto mucho más didáctico y con algunos chistes sobre ese momento histórico.

Esta indicación en tono de charla puede servir para pedirle que genere el texto desde la perspectiva de una segunda persona, que sea más enfático en alguna característica, que resuma la información en menos párrafos, y muchas más opciones que dependerá de lo que necesite cada uno.

FUENTE: INFOBAE.COM

:quality(85)/https://assets.iprofesional.com/assets/jpg/2024/11/587781.jpg)

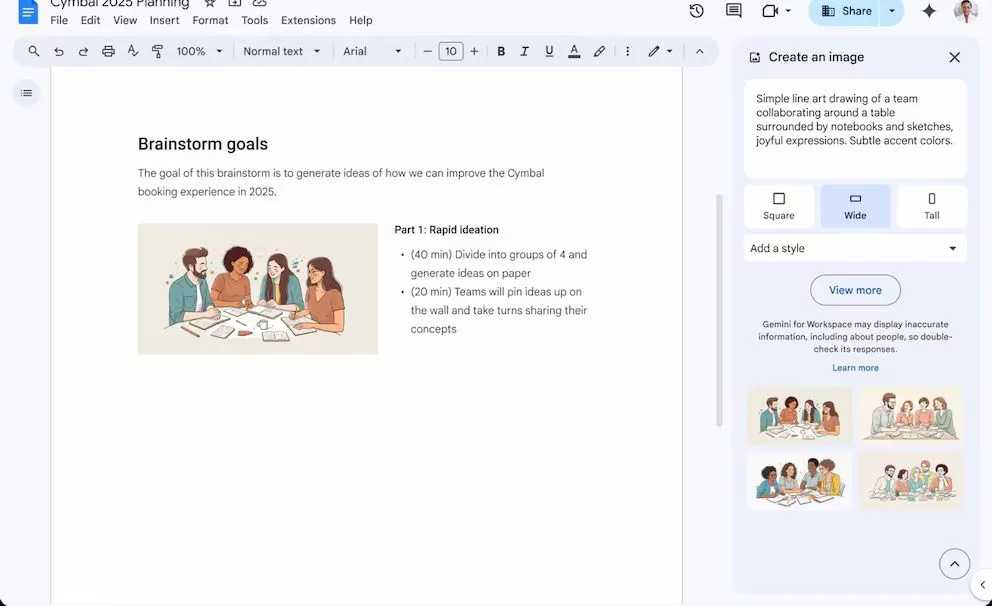

Google agrega la capacidad de generar imágenes con Gemini en Docs, impulsadas por Imagen 3

Lanzaron una startup local que ayuda a cobrar la cuota social de clubes y ONG y ya tienen clientes en 4 países

/cloudfront-us-east-1.images.arcpublishing.com/artear/GDXXDDFPD5CBXEFFK73V76RMTM.jpg)

/cloudfront-us-east-1.images.arcpublishing.com/artear/Z7US4HNNW5GSJG67IOA7QNR4BA.jpg)

/cloudfront-us-east-1.images.arcpublishing.com/artear/46WBZLYHNFFZLOGR7WVOUF5H5Y.jpg)

Habemus papam: Robert Prevost. Leon XIV, cardenal de Estados Unidos y de ascendencia española